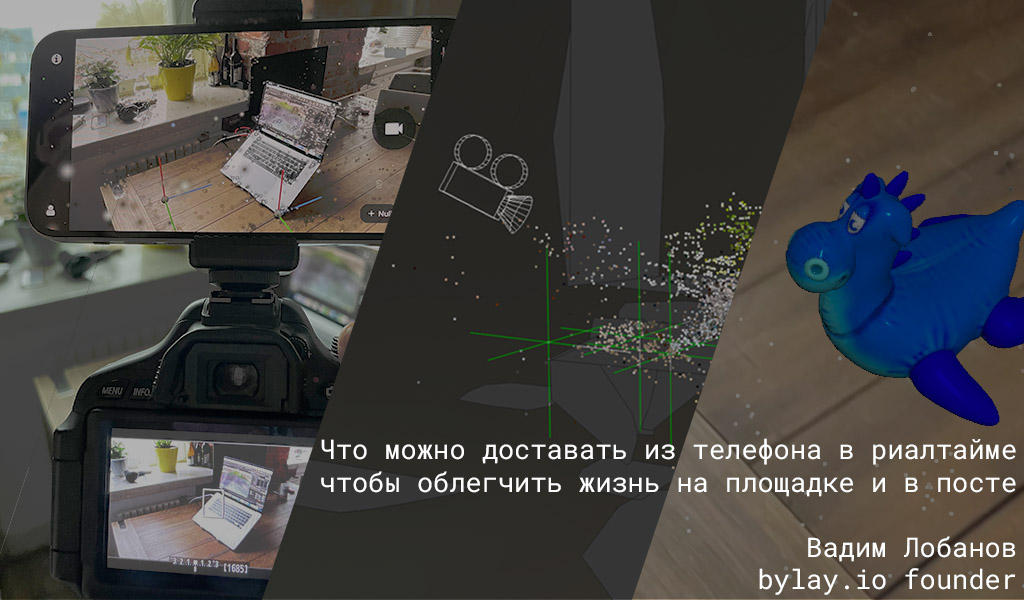

Что можно доставать из телефона в риалтайме, чтобы облегчить жизнь на площадке и в посте

Вадим Лобанов. Byplay

Современный телефон напичкан сенсорами и камерами, а Apple и Google тратят огромные ресурсы чтобы выжать из этих данных максимум и сделать движки дополненной реальности (AR) — ARKit и ARCore соответственно. Они выдают трекинг телефона в 60fps, при этом оценивая где находятся окна, двери и столы, генерируя HDR карту освещения и примерный мэш пространства — все для того чтобы пользователь мог посмотреть на тигра в полном размере на своей кухне.

Все это круто, но как нам использовать телефон в CG-продакшене?

На этом докладе обсудим:

1. Как работает AR и чем это отличается от традиционного трекинга

2. Какие данные обрабатывает телефон и что выдает; как трекинг зависит от освещения, характера движения и окружения

3. Как использовать телефон для трекинга профессиональной камеры, какие при этом возникают проблемы и как их решить

4. Как организовать плэйбэк в Unity или UE, чтобы видеть CG элементы сразу на площадке, какая для этого нужна подготовка

5. Что телефон знает о 3D пространстве и освещении и как это использовать в VFX софте

Автор

Вадим Лобанов, Byplay — Основатель и разработчик

Вадим — основатель стартапа Byplay, разработчик и инженер, в последние три года плавно переключающийся на решения для VFX

Среди проектов — AR туры в Hololens, определение глубины по видео нейросетками, полностью автоматический рендеринг пользовательских видео с эффектами в Houdini + Octane, кластерный рендеринг Blender Cycles на гибкой инфраструктуре в облаке.

Сделал два deepfake шота для фильма известного российского режиссера, премьера в 2021

Создатель Byplay Camera: https://80.lv/articles/new-ar-app-imports-video-and-camera-tracking-into-houdini-and-blender/ — приложения для записи видео с трекингом на телефоне и плагинами для импорта в Houdini, Blender, C4D

|| 3DScan, CG EVENT 2021 DIGITAL HUMANS, Mobile Apps, VFX